LLM 和生成式 AI(Open-AI | CHAT-GPT)在 SEO 中的应用

OpenAI的ChatGPT令人惊叹的写作能力,在大众的极大兴趣下,引发了无休止的在线社区辩论。作家们担心AI工具如ChatGPT会取代他们,但这种情况可能不会很快发生。当涉及写作时,它缺乏创意、独特性和人类的‘人情味’。

然而,对于一个作家来说,它可以是一个极好的补充工具,用于创造新想法,获得灵感,进行研究,减少单调乏味的任务,提高语法能力等等。许多作家已经加入了这一潮流,并开始在日常工作中使用Chat GPT。

ChatGPT的内容质量惊人,因此应该考虑将其用于SEO目的的想法。

ChatGPT如何实现它的功能

“谷歌可能只需一两年就能完全被破坏,” Gmail 创造者 Paul Buchheit 在推特上发表了这样的评论,并补充说,人工智能将能够“瞬间完成使用谷歌这样的搜索引擎需要花费很多时间才能完成的任务。”

简而言之,ChatGPT是一种称为大型学习模型的机器学习类型。

一个大型的学习模型是一种人造智能,它经过大量数据的训练可以预测一个句子中下一个单词。

它接受的训练数据越多,就能执行的任务种类越多。

有时,大型语言模型会开发出意想不到的能力。

斯坦福大学写道,训练数据的增加使得GPT-3能够将英文翻译成法文,即使它并没有专门接受这项任务的训练。

大型语言模型,如GPT-3(以及ChatGPT的基础GPT-3.5),并不是为执行特定任务而训练的。

他们接受广泛知识的培训,可以将其应用于其他领域。

这与人类学习的方式类似。例如,如果一个人学习了木工基础知识,即使那个人从未被专门教过如何做,他也可以应用这些知识来制作桌子。

GPT-3的工作原理类似于人脑,它包含可应用于多个任务的通用知识。

斯坦福大学关于 GPT-3 的文章解释:

与国际象棋引擎解决特定问题不同,人类“通常”具有智能,可以学会从写诗到踢足球到报税的任何事情。

与大多数当前的AI系统相比,GPT-3越来越接近这种通用智能...

ChatGPT 包含另一个名为 InstructGPT 的大型语言模型,该模型经过训练,可以接受人类的指示和对复杂问题的长篇答案。

这种遵循指示的能力使得ChatGPT 能够接受指示,以指定的方式创作几乎任何主题的文章。

它能在一定限制条件下写出一篇文章,如字数和包含特定主题要点。

ChatGPT可以写关于几乎所有话题的文章,因为它经过了在一般公众可获取的广泛文本上训练。

然而,在决定将其用于SEO项目之前,了解ChatGPT的限制是很重要的。

最大的限制是 ChatGPT 在生成准确信息方面不可靠。它不准确的原因是因为该模型仅在给定话题的段落中预测前一个单词后面应该出现哪些单词,它不关注准确性。

这应该是任何对创造优质内容感兴趣的人的头等大事。

1. 计划编制以避免某些种类的内容

例如,ChatGPT被特别编程为不生成关于图形暴力、显性性行为以及有害内容(如教授制作爆炸装置的指令)的文本。

2. 不知道当前事件。

另一个限制是它没有意识到在2021年之后创建的任何内容。

因此,如果您的内容需要保持最新和新鲜,那么目前的ChatGPT可能不是很有用。

3. 具有内置偏见

需要注意的一个重要限制是经过训练的AI是有益、真实和无害的。

那些不仅仅是理想,它们是内置在机器中的有意的偏见。

似乎将编程设为无害会使输出避免负面情绪。

那是个好事,但它也微妙地改变了这篇文章的中立性。

从某种意义上说,一个人不得不握住方向盘,并明确地告诉ChatGPT朝着期望的方向行驶。

以下是偏见如何改变输出的例子。

我要求ChatGPT以Raymond Carver的风格写一篇故事,以神秘小说作家Raymond Chandler的风格写另一篇故事。

两个故事都有积极的结局,这在两位作家的作品中都很不寻常。

为了得到符合我的期望的输出,我不得不给ChatGPT提供详细的指示,以避免欢快的结局,而对于Carver式的结局则要避免给故事一个解决,因为这正是雷蒙德·卡佛的故事通常的发展方式。

重点是ChatGPT有偏见,需要注意它们可能会影响输出。

4. ChatGPT 需要非常详细的说明。

ChatGPT需要详细的指导,以便输出更高质量的内容,有更大可能性高度原创或采取特定的观点。

给它更多的指令,它的输出将会更加复杂。

这既是一种优势,也是需要注意的限制。

请求内容中的指令越少,输出结果就越有可能与其他请求的输出结果相似。

作为测试,我复制了多人在Facebook上发布的查询和输出结果。

当我向ChatGPT提出完全相同的问题时,该系统生成了一篇完全原创的文章,其结构相似。

这些文章有所不同,但结构相同,涉及相似的子主题,但使用的词语完全不同。

ChatGPT旨在选择完全随机的单词来预测文章中下一个单词,因此它不会抄袭自己,保持HTML结构不变。

但是,类似的请求产生相似的文章这一事实突显了仅仅询问“给我这个”的限制。

5. ChatGPT的内容能被识别出来吗?

谷歌和其他机构的研究人员多年来一直致力于开发算法,成功检测人工智能生成的内容。

有很多关于这个话题的研究论文,我将提到一份来自2022年3月的论文,使用了GPT-2和GPT-3的输出。

这篇研究论文的标题是《生成变压器的检测中神经-统计特征的对抗鲁棒性》(PDF)。

研究员正在测试何种分析方法可以检测出采用旨在逃避检测的算法生成的AI内容。

他们尝试了一些策略,比如使用BERT算法用同义词替换单词、添加拼写错误等等。

他们发现,一些AI自动生成文本的统计特征,如Gunning-Fog指数和Flesch指数得分,有助于预测文本是否为计算机生成,即使该文本使用了旨在逃避检测的算法。

6. 隐形数字水印技术

更加有趣的是,OpenAI的研究人员开发了加密水印技术,可协助检测通过OpenAI产品如ChatGPT创建的内容。

最近一篇文章引起了广泛关注,该文章提到了一位OpenAI研究员的讨论,这个讨论可以在一段名为“Scott Aaronson Talks AI Safety”的视频中观看到。

研究人员表示,例如加水印等伦理人工智能实践可以演变成为行业标准,就像Robots.txt成为道德爬行的标准一样。

他说:

在过去的30年里,我们已经看到,大型互联网公司可以就某些最低标准达成一致意见,这可能是因为害怕被起诉、希望被视为负责任的参与者,或其他原因。

一个简单的例子是robots.txt:如果你不想让你的网站被搜索引擎索引,你可以指定它,主要的搜索引擎将会尊重它。

同样地,你可以想象一些像水印一样的东西,如果我们能够证明它有效、廉价、不影响产出的质量,不需要很多计算,等等,它将成为行业标准,任何想被视为负责任的玩家都会包含它。

研究员开发的数字水印技术基于密码学。任何拥有密钥的人都可以测试文档,以查看是否有数字水印,以显示文档是否由人工智能生成。

代码可以以标点符号的使用方式或单词选择的形式出现。

他解释了水印技术的工作原理以及其重要性:

目前为止,我的主要项目是打上统计水印工具,用于文本模型(如GPT)的输出。

基本上,无论何时GPT生成某些长文本,我们希望在其单词选择中存在一些不易察觉的秘密信号,您可以后来用来证明,是的,这来自GPT。

我们希望让从GPT输出内容变得更难以伪装成人类所写。

这可能有助于防止学术抄袭,显然,也有助于例如大规模生成的宣传,你知道,用似乎与主题有关的评论在支持俄罗斯入侵乌克兰的每个博客中发送垃圾信息,而没有任何位于莫斯科的巨量论坛用户的建筑物。

为了诽谤他人,模仿某人的写作风格。

这些都是人们希望让它更难的事情,对吧?

研究者分享说,水印技术可以打败算法试图逃避检测的尝试。

CHAT-GPT在SEO方面的限制

1. AI 内容是可检测的

许多人说Google无法知道内容是否是使用AI生成的。

我不明白为什么有人会持有那种看法,因为检测人工智能已经更多或更少解决了。

即使使用反检测算法的内容也会被检测到(如上述我链接的研究论文所述)。

检测机器生成的内容一直都是研究的主题之一,包括如何检测从其他语言翻译而来的内容的研究。

自动生成的内容违反Google的指导方针吗?

谷歌的约翰·米勒在2022年4月表示,使用人工智能生成的内容会违反谷歌的指南。

对我们而言,这些基本上仍属于自动生成的内容类别,这是我们自从一开始就存在于网络管理员指南中的内容。

人们已经以许多不同的方式自动产生内容了。而对于我们来说,如果你正在使用机器学习工具来生成你的内容,这与你只是随意搭配单词、查找同义词或者使用人们过去常用的翻译技巧是一样的。这些都是同类操作。

我的怀疑是可能内容质量比那些传统老式工具好一点,但对我们来说仍然是自动生成的内容,也就是说,对我们来说仍然违反网站管理员指南。因此,我们认为它是垃圾邮件。

Google 最近更新了有关垃圾邮件的“自动生成”内容部分,该部分包括了开发者页面。

创建于2022年10月,于2022年11月末进行了更新。

这些更改反映了关于什么构成自动生成内容垃圾邮件的澄清。

它最初的内容是这样的:

自动创建的(或“自动生成的”)内容是指通过编程生成的内容,没有产生任何原创性或添加足够的价值;

谷歌更新了那个句子,加入了“垃圾”的词。

“垃圾自动生成(或“自动生成”)内容是指通过编程自动生成的内容,没有生产任何原创内容或添加足够的价值;”

那个更改似乎澄清了,仅仅是自动生成的内容并不会使其成为垃圾信息。而缺乏所有附加价值和普遍的“垃圾”特质才会使该内容成为问题。

ChatGPT可以进行内容水印处理。

最后,OpenAI的研究员表示(在ChatGPT发布前的几周)水印将“希望”出现在下一个GPT版本中。

因此,如果ChatGPT尚未加水印,它可能在某个时候会升级加水印。

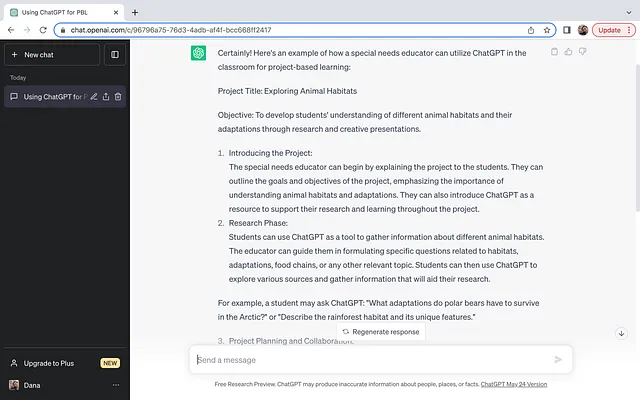

优化AI的使用AI工具的最佳用途是通过以让工人更有效率的方式扩大SEO。通常包括让AI完成繁琐的研究和分析工作。

总结网页内容以创建元描述可能是一种可接受的用途,因为谷歌明确表示这不违反其准则。

使用ChatGPT生成概述或内容简介可能是一个有趣的应用。

将内容创作交给人工智能并直接发布可能不是最有效的使用方式,如果没有首先对其质量、准确性和实用性进行审核。