可视化人工智能实体之间的交互:关于ChatGPT对话的研究

马雷克·库勒尔库普,布兰登·洛里茨,杰文·伊鲁斯,陶诺·塔姆

介绍

在对话 AI 的领域中,许多研究人员主要关注探索聊天机器人和人类之间的交互。然而,当两个人工智能代理(例如两个 ChatGPT 实例)进行对话时,会展现出令人着迷的动态。分析这些自动的讨论可以提供关于 AI 模型适应性、创造力、逻辑和语言学习的其他方面的见解,从而为模型改进和发现新的 AI 交互现象提供机会。本文深入探讨了研究这些独特对话的实验方法、数据来源、评估方法和可能的应用。

数据来源和实验设置

一个有趣的可用于研究贡献的数据集是botbots数据集,其中包含了两个ChatGPT实例之间的对话,涵盖了广泛的场景(从问答到头脑风暴)和下游任务(从酒店预订到医疗建议)。这些对话提供了有价值的资源,以分析聊天机器人模型的交互模式、创造力和适应性,尤其是OpenAI GPT-3.5-turbo模型。该数据集包括以下特性:

- 样本 ID(每个对话的特殊标识符)

- 长度(对话的长度)

- 温度(影响AI响应随机性的参数)

- 初始语(对话中的第一句话)

- 必要能力(处理对话所需的技能)

- 代理人1和代理人2(对话中的两个人工智能代理人)

- 话语(对话期间所作的声明)。

我们使用SBERT(Sentence-BERT)将对话中的句子转换为句子嵌入,SBERT是一种创建语义有意义的句子嵌入的框架。它基于流行的BERT(无方向编码器来自变形金刚)模型,它是由Google开发的最先进的语言表示模型。SBERT将句子编码为固定长度的向量,具有输入文本的语义意义。

t-SNE(t-分布随机邻居嵌入)是一个降低维度的著名技术。t-SNE算法将高维数据集映射到低维空间。关于这个项目,它使我们能够比较高维度聊天机器人对话。

研究结果

为了更深入地了解由AI生成的对话,我们利用数据集和可视化技术将结果以更易读的形式呈现。由于数据预处理和可视化技术针对不同的对话实现,因此我们选择了最有趣的对话。

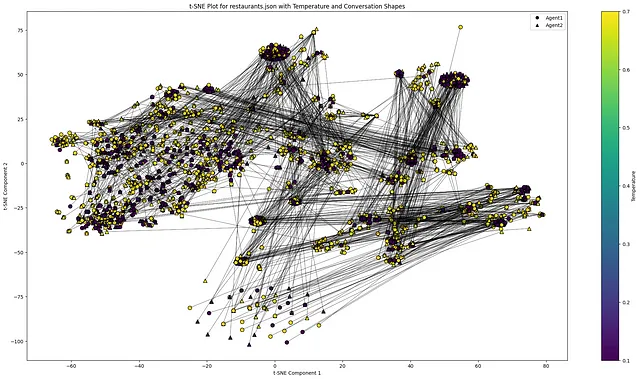

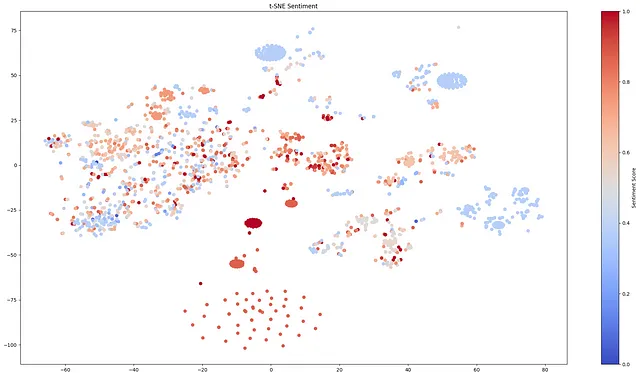

虽然其他会话数据集也会展示出些微聚集,但‘restaurants.json’数据集(图1)的温度图显示出了某些主题内强烈的聚集现象。只有带有非常高和非常低温度的对话。但在这种情况下,GPT模型的温度并不起重要作用。这些显著的聚集现象意味着聊天机器人的对话具有连续性和相似的模式。这可以表明聊天机器人从输入中生成出了相关的回复,可以进行有意义的对话。但是这并不一定意味着生成响应的输出是准确的,因为一致的模式可能包含错误或误导性信息。

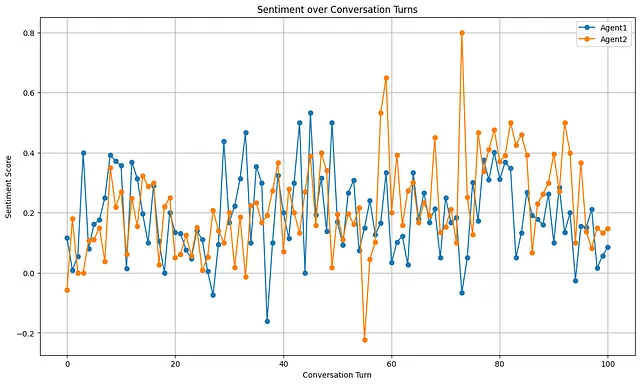

我们对“restaurants.json”数据集进行的情感分析提供了更深入的理解层面。数据集显示,聊天机器人对话往往会保持一致的情感,相似情感的聚类清晰地显现出来(图2、图3)。这一发现表明了聊天机器人的有趣能力:它们可以模仿情绪暗示。情感的理解和模仿在人类对话中至关重要,有助于情感共鸣和互动。因此,在人工智能驱动的对话中观察到这一点,表明了更具情感意识和响应能力的人工智能系统的潜力。

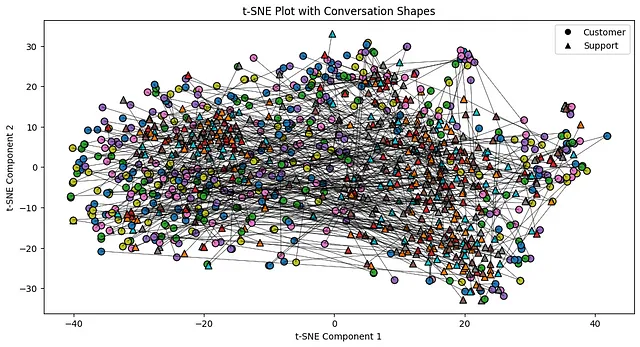

在图4中,我们展示了带有温度和交谈形状的reasoning.json图。正如我们所看到的,这里有更多的数据,数据点形成了强烈的聚类。此外,这次谈话的温度更加变化。一些聚类始终表现出较低的温度,而其他聚类则表现出更高的温度。当温度被设为更高的值,例如1.0时,响应往往更随机和多样化。反之,较低的温度值,如0.5或0.1,会导致更加集中和确定性的响应。

我们分析的启示部分涉及将AI对话与人对人交互进行比较。我们发现这些对话的结构和模式存在显著差异,为人工和自然对话的独特特征提供了新的视角。

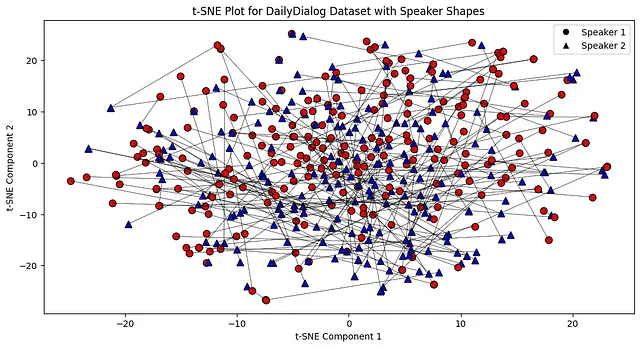

当我们研究了人与人之间的对话(图5,图6)时,我们发现与AI之间的对话相比,人类之间的对话具有更高的随机性和较少的聚集效应。人类之间的交流在温度和情感方面并没有形成明显的群集,展现出更加流畅和动态的对话模式。这很可能是由于人类沟通的内在复杂性和不可预测性,对话的流程可以迅速改变,取决于各种因素,例如情感、背景、个人经验和沟通风格。

另一方面,AI与AI之间的对话表现出明显的聚集,特别是在温度和情感方面。 AI回复的一致性表明更加受控和确定性的对话结构,很可能源于规定AI行为的定义规则和算法。这些发现突显了AI交互的独特方面,在这种情况下,聊天机器人似乎会反映彼此的情感并保持对话连贯性,形成不同的对话聚类。

虽然最初看起来 AI 之间的对话因为清晰的聚类更加结构化和连贯,但我们必须考虑到人类对话的丰富性和多样性是由经验、情感和思维过程的深度与广度导致的,而这是 AI 模型尚未完全复制的。

然而,这些发现不应被视为AI系统的缺点。相反,它们突显了AI模型进化和适应的潜力。通过理解这些差异并从人际对话的复杂性中学习,我们可以提高AI系统的多样性和响应能力。最终的目标是开发出能够理解并有效地回应人际对话,同时模拟人际对话的动态和深度的AI模型。这将显著增强它们与我们更有意义和上下文适宜的交流能力。

扩展发现

我们的分析揭示了人工智能之间交互的有趣动态,特别是对话中明确聚类的出现。这种聚类意味着像ChatGPT这样的人工智能模型倾向于生成在不同情境下表现出一致性和连贯性的对话。更值得注意的是,这些连贯的对话不仅限于一个特定的情境,而是涉及从常见的问答到任务特定的对话,如酒店预订或医疗建议的广泛主题范围。

这种一致性表明这些模型具有高度的适应性,它们不仅可以在不同的语境中进行对话,还可以保持一定的连贯性。它还突显出模型模拟对话模式的能力,显示出它们在参与对话时具有重要的“理解”或“学习”能力。

然而,这种一致性和连贯性并不一定等同于生成的回答的准确性。 我们的研究结果显示,虽然人工智能模型表现出一致的模式,但这些模式仍可能包含错误或误导性信息。这强调了继续研究和发展,以提高人工智能生成的回答的可靠性的重要性。

此外,我们的情感分析揭示了另一个迷人的方面:AI 模型反映情感暗示的能力。在人类对话中,反映情感暗示对于移情和参与至关重要。因此,这一发现表明 AI 模型具有更多的情感意识和响应能力,增强了它们进行更有意义和语境适当的对话的能力。

结论和未来研究

AI实体之间的交互探索,特别是ChatGPT实例之间的交互,为人工智能系统的对话能力提供了有价值的洞见。我们的研究结果强调了人工智能对话的独特方面,表现出清晰的连贯和情感镜像模式,与人类对话观察到的动态、复杂和不太可预测的模式显著不同。

然而,AI对话中的独特性和连贯性并不一定意味着优于人类对话。相反,人类对话看似随意的本质反映了人类沟通的丰富性,多样性和动态性。尽管AI系统已经取得了一定的进展,但它们尚未完全模拟人类对话的深度和复杂性。

这些观察并非揭示了缺点,而是为AI系统的潜在增长和发展提供了启示。对这些差异的深入理解可以指导更具有多功能和响应能力的AI模型的开发,使其能够应对人类交流的复杂性。

就未来研究而言,这些发现指向了许多有趣的可能性。例如,基于聊天机器人模拟情绪的观察能力,未来的研究可以努力提高人工智能系统对情感的理解和响应能力,最终导致更具移情和吸引力的聊天机器人。

此外,AI 对话中观察到的一致性可用于开发擅长在解决问题情境中进行谈判或团队合作的 AI 模型。设计和检查多个 AI 代理合作实现共同目标的情境将是很有趣的,并反映出人类团队合作的情况。

最后,将人工智能对话与人类对话之间的比较分析扩展到更多的不同背景和任务中,可以揭示出AI模型的适应性和创造力的更多见解。

总之,我们研究了ChatGPT实例之间的交互,不仅丰富了我们对AI对话的理解,还为未来在会话AI领域的研究开辟了令人兴奋的途径。这项工作的意义可能会彻底改变人类与AI之间的互动,并进一步缩小人工和自然对话之间的差距。